Votre panier est actuellement vide !

Intelligence artificielle : analyse concurrentielle

L’Autorité de la concurrence a formulé une série de 10 recommandations visant à favoriser la dynamique concurrentielle du secteur de l’IA.

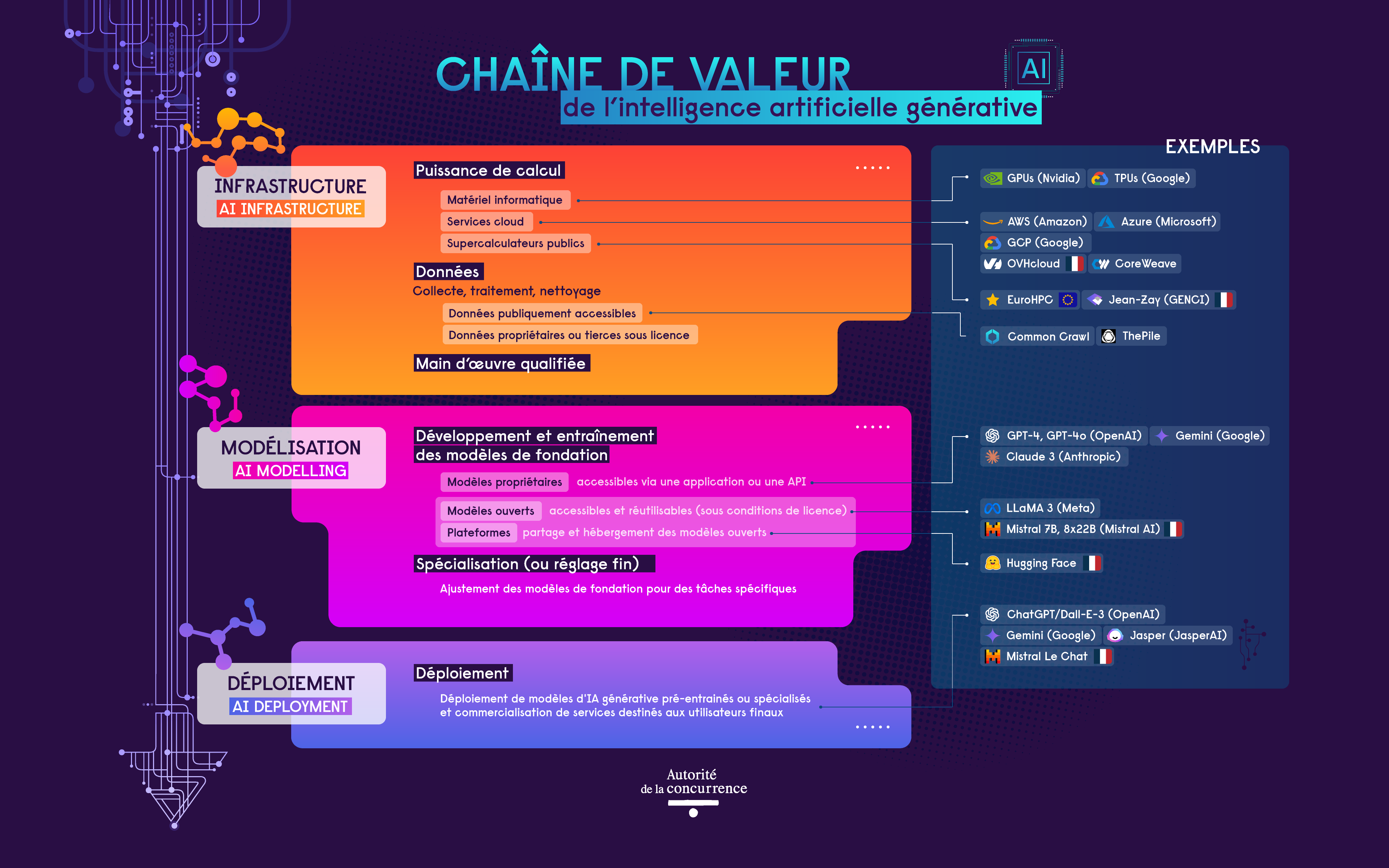

Ces recommandations n’appellent pas à une nouvelle réglementation mais visent à fournir aux acteurs du secteur une analyse concurrentielle du fonctionnement de ce marché en plein développement. Il se concentre plus particulièrement sur les stratégies mises en place par les grands acteurs du numérique visant à consolider leur pouvoir de marché à l’amont de la chaîne de valeur de l’IA générative, c’est-à-dire dans la conception, l’entraînement et la spécialisation des grands modèles de langage ou à tirer parti de ce pouvoir de marché pour se développer dans ce secteur en plein essor.

L’Autorité s’intéresse en particulier aux pratiques mises en œuvre par les acteurs déjà présents sur l’infrastructure d’informatique en nuage (cloud) et aux problématiques liées à l’accès à ces infrastructures, à la puissance de calcul, aux données et à une main d’œuvre qualifiée. Elle examine également les prises de participations et les partenariats des grands acteurs du numérique, notamment dans des entreprises innovantes spécialisées dans l’IA générative.

Elle n’aborde par conséquent qu’à titre incident les pratiques des acteurs à l’aval de la chaîne de valeur, c’est-à-dire au contact du consommateur final, et pas du tout les conséquences de l’IA pour le fonctionnement concurrentiel de l’ensemble de l’économie – question d’importance majeure et qui méritera des analyses ultérieures

Rendre plus efficace le cadre réglementaire applicable au secteur

La Commission devrait porter une attention particulière au développement des services permettant l’accès aux modèles d’IA générative dans le cloud (en anglais, Model as a Service ou MaaS) et évaluer la possibilité de désigner les entreprises fournissant de tels services en tant que contrôleurs d’accès pour ce qui concerne ces services dans le cadre du règlement européen sur les marchés numériques. Un certain nombre de comportements problématiques identifiés supra seraient ainsi prohibés ex ante.

Proposition n°1 : la Commission européenne devrait porter une attention particulière au développement des services MaaS pour évaluer la possibilité de désigner les entreprises fournissant de tels services en tant que contrôleurs d’accès dans le cadre du DMA.

L’Autorité encourage par ailleurs la DGCCRF à accorder une attention particulière à l’utilisation des avoirs d’informatique en nuage dans le domaine de l’IA, notamment dans le cadre de la mise en œuvre de la loi du 21 mai 2024 visant à sécuriser et réguler l’espace numérique.

Proposition n°2 : dans la mise en œuvre des dispositions de la loi SREN sur les avoirs d’informatique en nuage, la DGCCRF devrait accorder une attention particulière à l’utilisation de ces avoirs dans le domaine de l’IA.

L’Autorité appelle à la vigilance sur les effets du règlement sur l’IA sur la dynamique concurrentielle du secteur.

Proposition n°3 : le futur Bureau de l’IA, mis en place à l’article 64 du règlement sur l’IA, et l’autorité nationale compétente en France, qui sera désignée en application de l’article 70 du règlement sur l’IA, devront s’assurer d’une part que la mise en œuvre du règlement ne freine pas l’émergence ou l’expansion d’opérateurs de taille plus modeste, et d’autre part que les plus grands acteurs du secteur ne détournent pas le texte à leur avantage.

Une coordination internationale est nécessaire compte tenu des initiatives en cours en France, en Europe et dans le reste du monde, afin de s’assurer qu’elles ne créent pas de distorsions et de surcoûts pour les entreprises. Le sommet sur l’IA qu’accueillera la France au mois de février 2025 constituera l’occasion de renforcer la gouvernance mondiale de l’IA.

Mobiliser les outils du droit de la concurrence

L’Autorité appelle aussi au concours des autorités compétentes et à l’utilisation de tous les outils disponibles. Elle s’engage ainsi à rester vigilante dans le secteur de l’IA générative, au côté de la DGCCRF, afin de mobiliser, si nécessaire, l’ensemble de leurs outils respectifs pour agir de manière rapide et efficace.

Proposition n°4 : les autorités chargées de la régulation concurrentielle des marchés devront demeurer vigilantes dans le secteur de l’IA générative et mobiliser, si nécessaire, l’ensemble des outils à leur disposition pour agir de manière rapide et efficace.

Développer l’accès à la puissance de calcul

L’Autorité est favorable, comme de nombreux acteurs publics, au développement des supercalculateurs publics, qui constituent une alternative aux fournisseurs de cloud et permettent à des acteurs académiques notamment d’accéder à la puissance de calcul, ce qui est bénéfique pour l’innovation. L’Autorité est également favorable à leur ouverture, dans certaines conditions, à des opérateurs privés, contre rémunération.

Proposition n°5 : poursuivre les investissements dans le développement des supercalculateurs au niveau européen, pour permettre au plus grand nombre d’acteurs d’accéder à la puissance de calcul.

Proposition n°6 : le gouvernement et/ou les sociétés assurant la gestion des supercalculateurs pourraient engager une réflexion afin de proposer un cadre ouvert et non-discriminatoire permettant à des acteurs privés d’utiliser les ressources des supercalculateurs publics contre rémunération, tout en conservant la priorité aux recherches notamment académiques.

Proposition n°7 : en lien notamment avec l’AI Act, fixer des critères d’ouverture des modèles d’IA génératives entrainés sur des supercalculateurs publics.

Tenir compte de la valeur économique des données

Les accords entre ayants droit et développeurs devraient refléter l’importance relative de ces données pour les développeurs suivant les cas d’usage, et préciser le cadre dans lequel ces données peuvent être utilisées.

Proposition n°8 : les autorités publiques, notamment dans le cadre de la mission confiée par la Ministre de la culture au Conseil supérieur de la propriété littéraire et artistique, pourraient inciter les ayants droits à tenir compte de la valeur économique des données selon les cas d’usage (en introduisant par exemple des prix différenciés), et à proposer des offres groupées réduisant les coûts de transactions, ceci afin de garantir les capacités d’innovation des développeurs de modèles.

La sphère publique, lorsque cela est possible, doit jouer un rôle moteur dans le prolongement de l’ouverture des données publiques. Ces initiatives peuvent également permettre d’assurer une meilleure représentation de la langue et de la culture française (et européenne) parmi les modèles d’IA générative, où l’anglais prédomine actuellement.

Proposition n°9 : faciliter la mise à disposition des données de la sphère publique et privée pour l’entrainement ou le réglage fin de modèles d’IA générative, et encourager les initiatives publiques ou privées visant à diffuser les données francophones, qu’il s’agisse de textes, d’images ou de vidéos.

Assurer une meilleure transparence sur les prises de participations des géants du numérique

A droit constant, il convient d’assurer une meilleure transparence des participations minoritaires dans le secteur.

Proposition n°10 : à l’occasion de l’obligation d’information des concentrations prévue à l’article 14 du DMA, la Commission pourrait également demander, dans le modèle relatif à l’article 14 du règlement sur les marchés numériques, des informations sur les participations minoritaires détenues dans le même secteur d’activité que la cible.

Définition de l’intelligence artificielle

L’intelligence artificielle désigne, selon le Parlement européen, tout outil utilisé par une machine « afin de reproduire des comportements liés aux humains, tels que le raisonnement, la planification et la créativité ». On parle d’IA générative pour désigner des modèles d’IA capables de créer de nouveaux contenus qui peuvent par exemple être du texte, des images, du son ou des vidéos.

Le fonctionnement du secteur

Deux phases essentielles de la modélisation de l’IA générative sont à différencier :

- L’entrainement désigne le processus d’apprentissage initial du modèle (souvent appelé « modèle de fondation »qui incluent les grands modèles de langage, en anglais Large Language Model ou LLM), à l’occasion duquel ses paramètres, appelés « poids », seront déterminés. Cet entrainement nécessite à la fois une grande puissance de calcul et un volume important de données, généralement publiques. Il peut, éventuellement, être complété par une phase de spécialisation, aussi appelée réglage fin (en anglais, « fine tuning »), pendant laquelle le modèle va être adapté à une tâche particulière ou à un ensemble de données spécialisées (par exemple, juridiques ou de santé). La spécialisation se fait généralement à partir d’un ensemble plus petit de données propriétaires, et peut faire appel à l’expertise humaine ;

- L’inférence correspond à l’utilisation du modèle entrainé pour créer du contenu. Le modèle peut être mis à disposition des utilisateurs via une application, comme ChatGPT de la société OpenAI ou Le Chat de Mistral AI, ou une interface de programmation pour les développeurs. La puissance de calcul nécessaire dépend du nombre d’utilisateurs. A l’inverse de nombreux services numériques, le coût marginal de l’IA générative n’est pas négligeable, compte tenu du coût de ce calcul. L’inférence peut également être complétée par l’apport de nouvelles données (qui n’ont pas été utilisées pour l’entrainement), pour ancrer le modèle (en anglais « grounding »), par exemple dans l’actualité la plus récente.

Les acteurs de la chaîne de valeur

Les acteurs présents sur la chaîne de valeur de l’IA générative sont :

- les grands acteurs du numérique : Alphabet et Microsoft sont présents sur l’ensemble de la chaîne de valeur, tandis qu’Amazon, Apple, Meta et Nvidia sont seulement présents sur certaines couches spécifiques ;

- les développeurs de modèles : il peut s’agir de start-ups ou des laboratoires de recherches spécialisés en IA, comme Anthropic, HuggingFace, Mistral AI et OpenAI. Ces développeurs ont souvent noué des partenariats avec un ou plusieurs géants du numérique, comme OpenAI avec Microsoft et Anthropic avec Amazon et Google. Ils peuvent adopter une approche propriétaire ou ouverte pour la diffusion de leurs modèles.

À l’amont, plusieurs types d’acteurs sont présents.

- les fournisseurs de composants informatiques, comme la société Nvidia, développent des processeurs graphiques (GPU) et des accélérateurs d’IA, qui sont des composants indispensables à l’entrainement de modèles d’IA générative ;

- les fournisseurs de services d’informatique en nuage (cloud) comprennent à la fois des géants du numériques, appelés « hyperscalers », comme Amazon Web Services (AWS), Google Cloud Platform (GCP) et Microsoft Azure, des fournisseurs de cloud comme OVHCloud ainsi que des fournisseurs spécialisés dans l’IA comme CoreWeave. Les ressources de calcul nécessaires peuvent également être fournies par les supercalculateurs publics (comme Jean Zay en France).

À l’aval, de nombreux acteurs commercialisent de nouveaux services fondés sur l’IA générative à destination du grand public (comme ChatGPT), des entreprises et des acteurs publics, et/ou intègrent l’IA générative dans leurs services existants (comme Zoom).

Source : Autorité de la concurrence, inspiré de l’article ChatGPT, Bard & Co. : An introduction to AI for competition and regulatory lawyers de Thomas Höppner et Luke Streatfeild, 23 février 2023

Le fonctionnement concurrentiel de l’IA générative

La présence de barrières à l’entrée élevées

1. La nécessité de recourir à des processeurs spécialisés pour l’IA

L’accès à une puissance de calcul suffisante pour effectuer un grand nombre d’opérations en parallèle et dotée d’une forte précision pour déterminer plusieurs milliards de paramètres est essentiel pour développer un modèle de fondation. Les processeurs graphiques développés par Nvidia (associés au logiciel CUDA) ou les accélérateurs d’IA développés par les grands acteurs du numérique (comme les unités de traitement tensoriel (TPU) de Google) sont indispensables pour l’entrainement, le réglage fin et l’inférence des modèles d’IA générative. Ils sont également très coûteux. Or ce secteur est caractérisé depuis 2023 par des difficultés d’approvisionnement dues à une explosion de la demande.

2. L’importance des services cloud

Le cloud apparait comme un passage obligé pour accéder à la puissance de calcul nécessaire à l’entrainement de modèle. Il est également un vecteur de diffusion des modèles en aval sur les places de marchés. Ces places de marché permettent aux développeurs de rendre leurs modèles facilement accessibles aux entreprises utilisatrices de services cloud, ce qui encourage les développeurs à rendre leurs modèles disponibles sur chacun des fournisseurs de cloud.

3. La nécessité de disposer de larges volumes de données

En l’état actuel de la technologie de l’IA générative, fondée sur les grands modèles de langage, les données sont un intrant fondamental pour les acteurs de ce marché. Ces données – qui peuvent être du texte, des images ou de la vidéo – sont principalement issues de sources publiquement accessibles, comme les pages Internet, ou de jeux de données comme les archives Web de Common Crawl (organisation qui fournit gratuitement des données issues d’Internet depuis 2008). Le nettoyage et le traitement de ces données constituent un facteur différenciant, les acteurs devant les filtrer pour ne garder que le contenu de qualité.

Les acteurs du secteur interrogés dans le cadre de cet avis ont exprimé des inquiétudes sur l’accès aux données, compte tenu de la crainte que les données publiquement accessibles ne suffisent pas à l’avenir et les incertitudes juridiques liées aux actions en justice intentées par plusieurs ayants droit, telle la plainte déposée par le New York Times contre OpenAI et Microsoft.

4. Des compétences rares et très recherchées

Les développeurs de modèles doivent avoir des connaissances pointues en science des données, par exemple en apprentissage automatique (« machine learning ») et en apprentissage profond, pour être capables à la fois de développer le code et de mettre en place l’architecture pour l’exécuter de manière performante. En plus de leur formation théorique, les ingénieurs doivent avoir des compétences empiriques qui ne peuvent être acquises qu’en travaillant avec ces modèles.

5. Un besoin de financement important

L’ampleur des investissements requis crée des barrières à l’entrée significatives et ce d’autant plus qu’ils doivent être renouvelés continuellement. L’Autorité relève à cet égard que les investissements dans le secteur ont été multipliés par près de six entre 2022 et 2023. Les entreprises du secteur ont ainsi levé plus de 22 milliards de dollars en 2023 (soit environ 20 milliards d’euros), contre environ 4 milliards de dollars en 2022 (soit environ 3,7 milliards d’euros).

Des évolutions techniques ou organisationnelles et certaines politiques publiques peuvent permettre de limiter ces barrières à l’entrée :

- L’existence de supercalculateurs publics : ceux-ci peuvent être utilisés gratuitement en échange d’une contribution à la science ouverte, ce qui permet à de nombreux acteurs, notamment académiques mais également des acteurs privés, d’accéder à la puissance de calcul pour l’entrainement ou le réglage fin de modèles d’IA générative.

- L’émergence d’innovations technologiques réduisant le besoin en puissance de calcul et en données, commele recours à des modèles de taille réduite ou encore à des données synthétiques (générées par IA) qui permettent de remplacer en partie les données réelles et de réduire les risques d’utilisation de données personnelles.

- L’existence de modèles ouverts : cette technologie permet à d’autres acteurs de réutiliser les modèles ou de les spécialiser.

La position de certains acteurs sur d’autres marchés en lien avec l’IA générative pourrait engendrer différents avantages concurrentiels

1. L’accès privilégié aux intrants

Les grandes entreprises du numérique bénéficient d’un accès privilégié aux intrants nécessaires pour l’entrainement et le développement des modèles de fondation. Ces avantages ne sont pas aisément réplicables par les développeurs de modèles de fondation concurrents qui n’ont pas accès à ces intrants dans les mêmes conditions.

- Elles ont en effet un accès facilité à la puissance de calcul en tant que partenaires et concurrents des fournisseurs de puces pour l’IA. D’une part, elles ont la capacité d’acheter en grande quantité et négocier des accords préférentiels avec des fournisseurs de processeurs graphiques comme Nvidia. D’autre part, la plupart de ces grandes entreprises développent également en interne des accélérateurs d’IA spécifiquement adaptés à leurs écosystèmes comme les TPU de Google, Trainium d’AWS. Des alternatives au logiciel CUDA de Nvidia commencent également à être développées.

- Ces entreprises bénéficient également d’un accès privilégié à un large volume de données (comme Alphabet avec YouTube qui lui offre une source majeure de données d’entrainement pour les modèles d’IA). Elles peuvent également accéder à des données associées à l’utilisation de leurs services en interne. Elles peuvent aussi utiliser leur puissance financière pour conclure des accords avec des propriétaires de données tierces comme le montre l’accord conclu par Google pour un montant de 60 millions de dollars (soit environ 55 millions d’euros) par an pour accéder aux données de Reddit, un site communautaire américain de discussions et d’actualités sociales.

- Par ailleurs, un grand nombre de talents sont attirés par les salaires attractifs ainsi que les conditions de travail, offerts au sein des grandes entreprises du numérique.

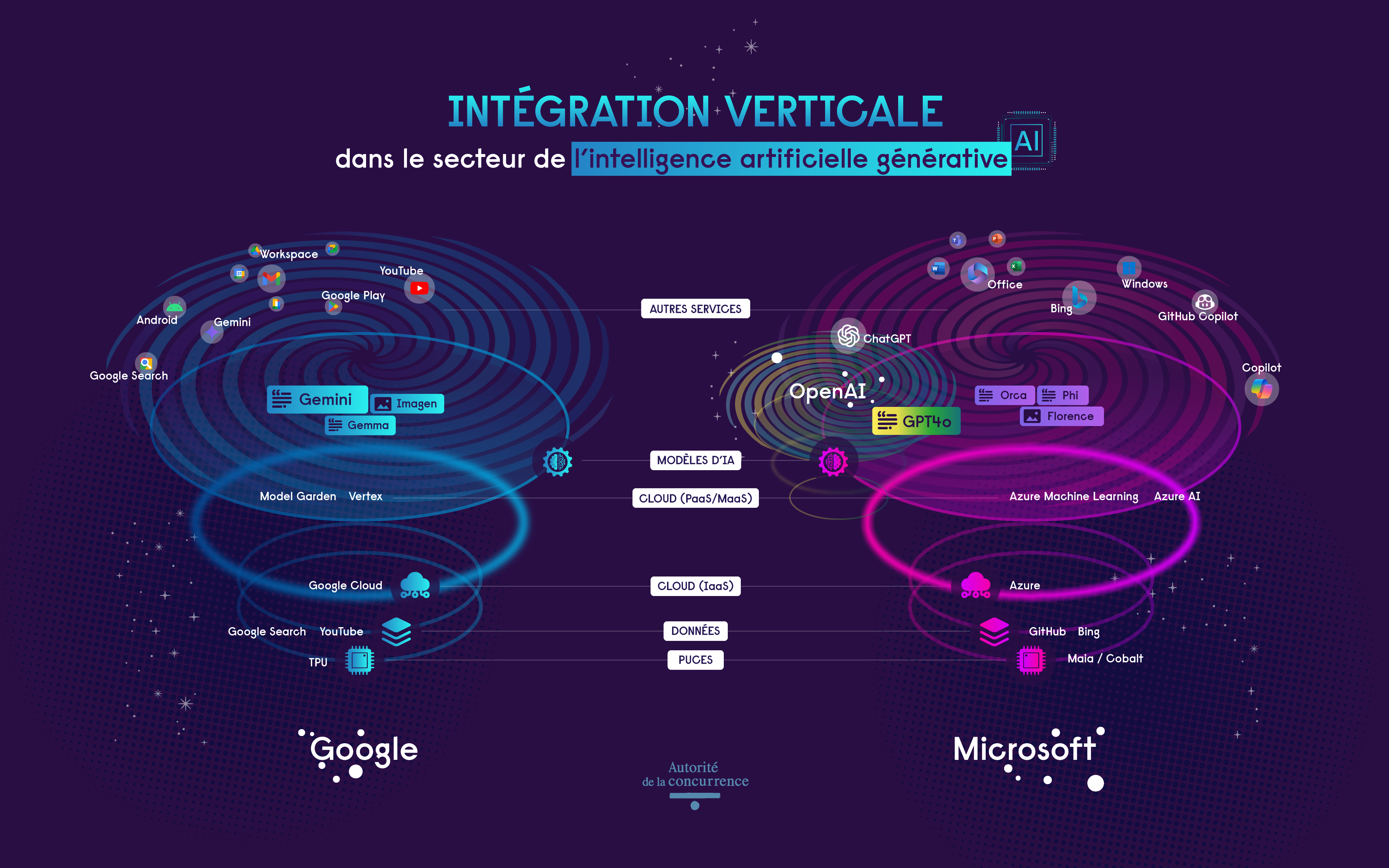

Les avantages découlant de leur intégration verticale et conglomérale

2. Les avantages découlant de leur intégration verticale et conglomérale

Au-delà d’un accès inégalé aux intrants nécessaires pour l’entrainement de modèles d’IA générative, les grandes entreprises du numérique bénéficient d’avantages liés à leur intégration verticale et conglomérale, comme des économies d’échelle, de gamme et des effets de réseaux de nature cumulative, puisque les données de retour des utilisateurs permettent d’affiner les futurs modèles et d’améliorer leur performance ou de proposer de nouveaux services.

L’Autorité constate également que ces entreprises commencent à intégrer les outils d’IA générative dans leurs écosystèmes de produits et de services. Ainsi, Microsoft déploie ses propres modèles et ceux de son partenaire OpenAI dans la fonction « Copilot » afin d’améliorer la fonctionnalité de recherche de Microsoft Bing et propose un assistant IA conçu pour fonctionner avec l’offre Microsoft 365. Par ailleurs, les places de marché de modèles (MaaS) de ces grandes entreprises permettent d’accéder à des modèles d’IA générative, propriétaires ou de tiers, conçus pour fonctionner dans leur écosystème.

L’accès de ces grandes entreprises du numérique aux intrants clés du développement de l’IA générative leur confère un avantage immense sur leurs concurrents. Cet avantage est renforcé par leur intégration sur l’ensemble de la chaîne de valeur ainsi que sur des marchés liés, ce qui leur génère notamment des économies d’échelle et de gamme, mais leur garantit aussi l’accès à une masse critique d’utilisateurs.

Les risques concurrentiels à l’amont de la chaîne de valeur

1. Les risques d’abus au niveau des composants informatiques

L’Autorité constate plusieurs risques potentiels tels que des fixations des prix, des restrictions de la production, des conditions contractuelles déloyales ou des comportements discriminatoires. Par ailleurs, des préoccupations relatives à la dépendance du secteur envers le logiciel de programmation de puces CUDA de Nvidia (seul environnement parfaitement compatible avec les GPU devenus incontournables pour le calcul accéléré) ont été exprimées. Les récentes annonces d’investissements de Nvidia dans des fournisseurs de services cloud spécialisés dans l’IA, tels que Coreweave, suscitent également des inquiétudes.

Ce secteur, qui a été visé par une opération de visite et saisie inopinée en septembre 2023, est attentivement scruté par les services d’instruction de l’Autorité.

2. Les risques de verrouillage par les grands fournisseurs de services cloud

L’Autorité constate que plusieurs pratiques de verrouillage financier et technique, déjà identifiées lors de l’avis 23-A-08 sur le cloud, semblent perdurer et même s’intensifier afin d’attirer le plus grand nombre de start-ups actives dans le secteur de l’IA générative. Outre, les offres de crédits cloud, particulièrement élevés, proposées aux entreprises innovantes du secteur, l’Autorité a identifié plusieurs pratiques de verrouillage technique (comme des obstacles à la migration).

L’Autorité rappelle à cet égard que ces pratiques pourraient être appréhendées notamment sur le fondement de l’abus de position dominante. Certaines de ces pratiques sont également encadrées par la loi n° 2024-449 du 21 mai 2024 visant à sécuriser et à réguler l’espace numérique (« loi SREN »), sur laquelle l’Autorité s’était prononcée, ou par le règlement européen sur les données (« Data Act »).

3. Les risques autour de l’accès aux données

Les entreprises innovantes du secteur pourraient être confrontées à des pratiques de refus d’accès ou d’accès discriminatoire à la donnée sur l’ensemble de la chaîne de valeur.

Par ailleurs, des accords par lesquels de grandes entreprises du numérique se réserveraient l’exclusivité de l’accès aux données des créateurs de contenu ou leur verseraient des rémunérations importantes difficilement réplicables par leurs concurrents pourraient constituer des pratiques anticoncurrentielles (ententes ou abus).

L’accès aux données des utilisateurs constitue également un enjeu majeur. En effet, plusieurs acteurs rapportent que les grandes entreprises du secteur continuent d’utiliser diverses stratégies pour limiter l’accès des tiers aux données de leurs utilisateurs en faisant un usage abusif de règles juridiques, comme la protection des données personnelles, ou encore de préoccupations de sécurité.

Il convient enfin de relever que les éditeurs de contenus expriment de grandes préoccupations liées à l’exploitation de leurs contenus par les fournisseurs de modèles de fondation, sans l’autorisation des détenteurs de droits. La décision récente de l’Autorité de la concurrence dans l’affaire des « droits voisins » a ainsi établi que Google avait utilisé aux fins d’entraînement de son modèle de fondation Gemini (anciennement « Bard ») des contenus des éditeurs et agences de presse, sans les avertir et sans leur permettre d’exercer de manière effective leur droit de retrait. Si cette question soulève des problématiques de respect des droits de propriété intellectuelle qui vont au-delà du champ d’étude du présent avis, le droit de la concurrence pourrait, sur le principe, appréhender ces questions sur le fondement d’une atteinte à la loyauté des transactions, par exemple, et donc, de l’abus d’exploitation.

4. Les risques liés à l’accès à une main d’œuvre qualifiée

Au-delà des accords de fixation des salaires entre entreprises, les accords de non-débauchage (« no-poach ») peuvent également constituer des pratiques anticoncurrentielles prohibées.

Un sujet de préoccupation additionnel consiste dans le recrutement, par les géants du numérique, d’équipes entières (comme par exemple le recrutement par Microsoft d’une grande partie des 70 employés de la start-up Inflection) ou d’employés stratégiques de développeurs de modèles (comme le bref recrutement par Microsoft de Sam Altman, le fondateur d’OpenAI avant qu’il ne soit finalement réintégré dans la société). Si ce type de pratiques peut être examiné sous l’angle du contrôle des concentrations, il peut également s’analyser en une tentative d’exclusion de concurrents du secteur.

5. Les risques liés aux modèles en accès libre

Si les modèles en accès libre peuvent permettre d’abaisser les barrières à l’entrée, ils peuvent également susciter des préoccupations de concurrence. En effet, dans certains cas, les conditions d’accès et de réutilisation des modèles ou de certains de leurs composants peuvent conduire au verrouillage des utilisateurs.

6. Les risques liés à la présence d’entreprises sur plusieurs marchés distincts

L’intégration verticale de certains acteurs du numérique et leur écosystème de services sont susceptibles de donner lieu à plusieurs pratiques abusives.

À l’amont, les développeurs de modèles pourraient se voir opposer un refus ou des limites d’accès à des puces ou des données nécessaires pour entrainer des modèles de fondation concurrents. Cette pratique pourrait avoir pour effet d’entrainer des retards ou de conduire à la mise en place de modèles moins ambitieux, nuisant ainsi au maintien d’une concurrence effective sur le marché. Plusieurs acteurs s’inquiètent également des accords d’exclusivité existants entre des fournisseurs de services cloud et les principaux développeurs de modèles de fondation.

D’autres risques découlent de l’utilisation en aval des modèles d’IA générative, par des pratiques de ventes liées. Les entreprises détenant des positions prééminentes ou dominantes sur des marchés connexes à l’IA pourraient lier la vente de ces produits ou services à celle de leurs propres solutions d’IA. L’intégration d’outils d’IA générative sur certains supports comme les smartphones suscitent notamment des inquiétudes. Ce type de pratiques pourrait consolider durablement le secteur de l’IA générative autour d’entreprises numériques déjà dominantes.

Les concurrents en aval pourraient également être lésés par des pratiques d’auto-préférence de la part d’acteurs verticalement intégrés affectant la capacité des développeurs de modèles non intégrés verticalement à les concurrencer.

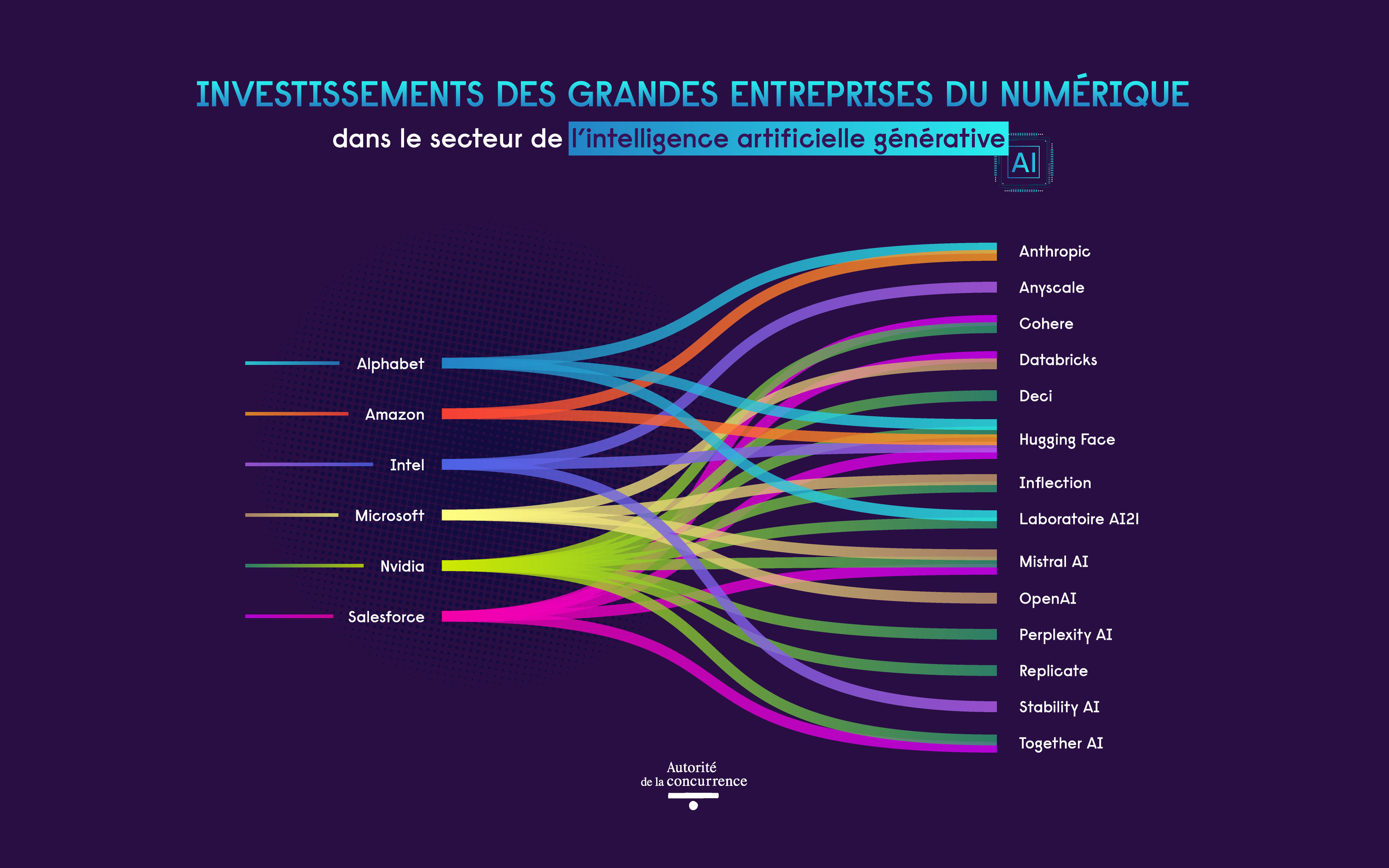

7. Les risques liés aux prises de participations minoritaires et partenariats des géants du numérique

Les investissements et les partenariats entre acteurs du secteur peuvent permettre aux start-ups du secteur de bénéficier de ressources financières et technologiques des grandes entreprises et ainsi favoriser l’innovation. Pour l’acquéreur, ces investissements permettent de se diversifier ou d’avoir accès à des technologies innovantes de nature à améliorer la qualité de ses services. Par exemple, Microsoft a noué un partenariat exclusif avec la société OpenAI sous la forme d’un investissement pluriannuel.

Ils présentent néanmoins des risques concurrentiels non-négligeables qui appellent à la vigilance particulière des autorités de concurrence. Ils peuvent en effet affaiblir l’intensité concurrentielle entre les deux entités, entrainer des effets verticaux, un renforcement de la transparence sur le marché ou un verrouillage de certains acteurs.

Les prises de participations minoritaires des grands acteurs peuvent être appréhendées par les autorités de concurrence sur plusieurs fondements, sous l’angle par exemple du contrôle des concentrations ou des pratiques anticoncurrentielles.

L’Autorité constate toutefois un manque de transparence sur ces accords, ce qui ne permet pas toujours de déterminer si ceux-ci peuvent nuire à la concurrence et donc aux consommateurs. Ces inquiétudes sont partagées par les autorités de concurrence dans le monde, comme le montrent notamment les investigations en cours concernant Alphabet, Amazon, Anthropic, Microsoft et OpenAI.

Source : Autorité de la concurrence inspirée par l’article de S&P Global, Untangling the web of strategic tech investments in generative AI, 22 février 2024

8. Les risques de collusion entre entreprises du secteur

Si la quasi-totalité des parties prenantes interrogées lors de la consultation publique de l’Autorité n’ont pas fait état d’inquiétudes spécifiques sur cette question, l’utilisation de l’IA générative pourrait potentiellement favoriser les pratiques concertées qui ont fait l’objet en 2019 d’une étude commune de l’Autorité et du Bundeskartellamt, comme l’utilisation parallèle d’algorithmes individuels distincts ou le recours à des algorithmes d’apprentissage automatique. Là encore, la vigilance s’impose.

Source : Autorité de la concurrence